私たちがこれまで親しんできた「AIに質問して、答えをもらう」という常識が、過去のものになろうとしています。

2026年4月22日から24日にかけて、米国ラスベガスで開催されたGoogleの企業向け年次イベント「Google Cloud Next ’26」において、世界のビジネス構造を根底から覆す極めて重要な発表が行われました。それは、人間からの指示をただ待つだけのチャット型AIから、自ら目標を理解し、計画を立て、他のシステムやAIと連携して任務を完遂する「自律型AIエージェント」への本格的な移行宣言です。

これまで、AIはあくまで高度な「文房具」や「検索ツール」のような位置づけでした。しかし、今回発表された新たなプラットフォームは、AIが私たちと同じように考え、判断し、実行する「同僚」へと進化を遂げたことを意味しています。なぜこの変化が世界中の企業や技術者を驚嘆させているのか、そして私たちの働き方や社会生活にどのような影響をもたらすのか、その本質的な意味を解き明かしていきます。

指示を待たず自ら動き出す。Googleが示したエージェントの時代とは

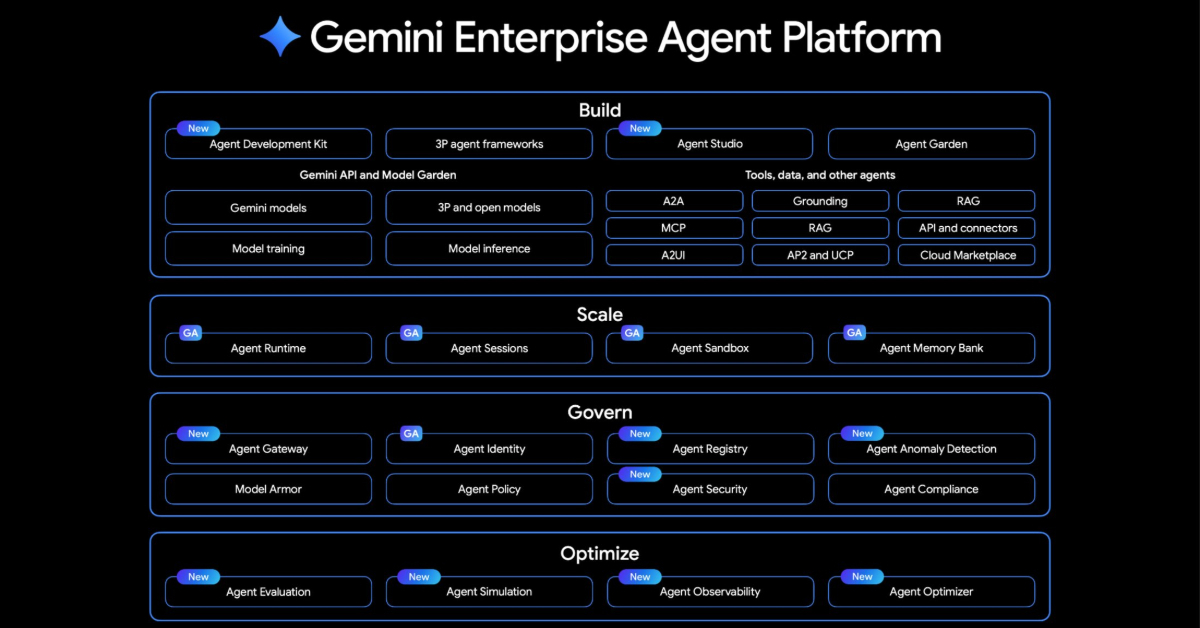

今回のイベントで最も象徴的だったのは、「Gemini Enterprise Agent Platform」と呼ばれる新たな基盤の発表です。これは、単一のAIモデルがすべての処理を行うのではなく、特定の専門知識や役割を与えられた複数の「AIエージェント」が、チームとして協力しながら自律的にタスクを処理していく仕組みです。

イベントの基調講演で披露されたデモンストレーションは、これまでのAIの限界をあっさりと越えるものでした。提示されたお題は「ラスベガスで開催される1万人規模のマラソン大会を設計・運営する」という非常に複雑なプロジェクトです。従来のAIであれば、コースの案や必要な機材のリストを出力して終わりでした。

しかし、今回示された自律型AIエージェントは全く違います。

「予算管理を担当するAI」「スケジュールとコース設計を担当するAI」「人材とリソース調達を担当するAI」というように、役割の異なるAIたちがシステム上で立ち上がり、お互いに自律的なコミュニケーションを始めました。予算担当のAIが「そのコース案では警備費用が予算をオーバーします」と指摘すれば、コース設計担当のAIが「では、迂回ルートを減らして人員を削減できるこちらの案に変更します」といった具合に、人間が間に入ることなく、AI同士が議論と調整を行い、最終的なプロジェクト計画を自動的に組み上げていったのです。

さらに、この自律性はサイバーセキュリティの分野にも応用されています。「Agentic Defense(能動的防御)」として発表された機能では、システムの異常を検知したAIエージェントが、ただ人間にアラートを出すだけでなく、過去のデータや外部の脅威情報に基づいて自ら原因を調査し、被害を食い止めるための防御策を自動的に実行するプロセスがプレビュー公開されました。

これらの発表が意味するのは、AIが「思考の補助」から「プロセスの実行者」へと完全にステップアップしたという事実です。データ分析のインフラから最前線のアプリケーションに至るまで、Googleはクラウド環境全体を「AIが自律行動するための広大な遊び場」へと作り変えようとしています。

究極の業務効率化への期待と、「AIに仕事を丸投げする」ことへの根強い不安

この「自律型AIエージェント」の本格的な到来に対して、世間や主要メディアの反応は大きな期待と慎重な警戒が入り混じっています。

テクノロジー業界や経済界からは、圧倒的な賛辞と期待の声が上がっています。特に深刻な労働力不足に直面している日本のような国において、複数の業務プロセスを自律的に進行できるAIは、究極の救世主と見なされています。企画書の作成から関係各所へのメール送信、スケジュールの調整、データ入力に至るまで、これまで人間が行っていた「作業のつなぎ目」をAIが埋めてくれることで、企業はかつてないレベルの生産性向上を実現できるという論調が主流です。

一方で、ビジネスの現場や専門家からは、「AIの暴走」や「責任の所在」に関する懸念が強く示されています。

AIが自ら判断して行動するということは、そのプロセスが人間の目から見えにくくなる「ブラックボックス化」を意味します。もし、予算調整を任されたAIエージェントが、数字のつじつまを合わせるために重要な安全対策の費用を勝手に削ってしまったらどうなるでしょうか。あるいは、顧客対応を行うAIが誤った情報に基づいて自律的に契約処理を進めてしまった場合、その責任はAIを導入した企業にあるのか、システムを提供したGoogleにあるのかという法的・倫理的な問題が浮上します。

これまでのAIは「人間が確認して承認する」という最終関門がありましたが、自律型AIはそのプロセスすらスキップしようとしています。利便性が極限まで高まる反面、私たちは「どこまでシステムを信頼し、どこまで権限を委譲すべきなのか」という、非常に難しい境界線の設定を迫られていると報じられています。

AIが「道具」から「自律した同僚」へ変わる時、人間のマネジメント対象が劇変する

ここで少し視点を変えて、このテクノロジーの進化がもたらす「別の本質」について考察してみます。一般的な報道では「業務が自動化されて楽になる」「情報漏えいのリスクが怖い」といった表面的なメリットとデメリットが語られがちですが、本当に注目すべきは「人間とAIの主従関係の逆転」と「求められる能力の根本的なシフト」です。

これまで、優れたプロンプト(指示文)を書く能力が重宝されてきました。AIを「道具」として扱う以上、いかに正確に手順を指示し、望み通りの結果を出力させるかという「How(どのようにやるか)」のスキルが重要だったからです。

しかし、自律型AIエージェントの時代になると、この「How」を考えること自体がAIの仕事になります。マラソン大会の例で言えば、「どうやって警備の予算を削るか」を考えるのはAIの役目です。

そうなると、私たち人間の役割は「How」を指示するオペレーターから、目指すべき方向性を示す「マネージャー」へと完全に切り替わります。

人間が問われるようになるのは、「そもそもなぜそのマラソン大会を開催するのか(Why)」「大会を通じて社会にどのような価値を提供すべきか(What)」という、極めて抽象的で倫理的な哲学の定義です。

これまで私たちは、目の前の事務作業や調整業務に追われるあまり、「何のためにこの仕事をしているのか」という根源的な問いを後回しにしてきました。しかし、自律型AIが物理的な「作業」をすべて引き受けてくれるようになれば、皮肉なことに、人間は最も人間らしい「意義や価値の創出」から逃げることができなくなります。

この変化は、特定の業務がなくなるという単純な話ではなく、ビジネスにおける「価値の源泉」が、処理能力の高さから、思想やビジョンの深さへと完全に移譲されるという歴史的な転換点を意味しているのです。

人間は「指示出し」から「目的の定義」へ。自律型AIと共に働く未来のビジネス像

AIが思考プロセス自体を担うというこの独自の洞察を踏まえると、これから数年の間に私たちの仕事や社会は劇的な変化を迎えることになります。

遠くない未来、企業のあらゆる部署に「専属のAIエージェント」が配属されるのが当たり前になるでしょう。営業部のAIと法務部のAIが、システム上で瞬時に契約書の文面を交渉・調整し、人間が朝出社した時にはすでに「最もリスクが低く、利益が最大化される契約の最終案」が机の上に置かれている状態になります。

このような環境下では、細かなエクセル作業が速い人や、社内調整に長けている人の価値は相対的に低下していきます。代わりに求められるのは、AIが導き出した複数の完璧な選択肢の中から、企業の理念や社会的な道徳に照らし合わせて「最後の決断を下す」という重い責任を背負える人材です。

また、私たちの生活面においても、複雑な手続きや情報収集はAIエージェントが背後で自律的に処理するようになります。旅行の計画から引っ越しの手配、資産の運用に至るまで、私たちは「こうしたい」という曖昧な願望を伝えるだけで、複数のAIが連携して最適な手配を完了させてくれる世界が訪れます。

Google Cloud Next ’26が私たちに突きつけたのは、単なる新技術のお披露目ではありません。それは「手足を動かす仕事はシステムに任せ、人間は人間でしかできない高度な判断と、温かみのある対話に集中せよ」という、強烈なメッセージです。自律型AIという強力な同僚を迎える準備として、私たち自身の「働く目的」を今一度問い直す時期が到来しています。

参考文献・出典元:Google Cloud Next ’26における主要な公式情報と報道

ITmedia AI+・Google Cloud Next 2026での発表内容まとめ 自律型AIエージェントへ

クラウドエース株式会社・【速報まとめ】Google Cloud Next ’26 Las Vegas 基調講演

G-gen Tech Blog・Google Cloud Next ’26速報レポート – キーノート

コメント